O Google lançou um aplicativo de inteligência artificial (IA) para comemorar o Dia Mundial da Conscientização sobre Acessibilidade. Isso ajuda as pessoas com deficiência a obter mais informações sobre o ambiente ao seu redor e a se comunicar facilmente.

The Verge informou no dia 17 (horário local) que o Google lançou vários aplicativos móveis para melhorar a acessibilidade para pessoas com deficiência.

A terceira quinta-feira de maio de cada ano é o Dia Mundial da Conscientização sobre Acessibilidade. O Google disse que está “comprometido com parcerias contínuas com a comunidade de deficientes para melhorar nossos recursos de acessibilidade”.

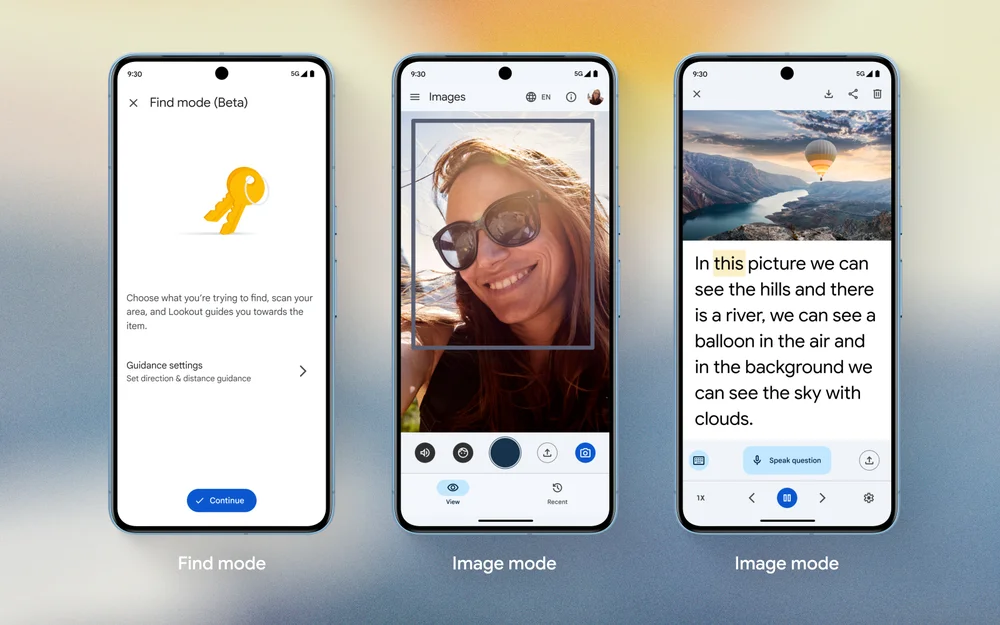

Primeiro, apresentamos o “Lookout”, um aplicativo Android que ajuda pessoas com deficiência visual ou com deficiência visual a realizar tarefas com facilidade e rapidez. Com o Lookout with Vision AI, você pode usar facilmente a câmera do seu telefone para aprender mais sobre o mundo ao seu redor e lidar com tarefas diárias com mais eficiência, como classificar correspondências ou estocar mantimentos.

O aplicativo permite que você escolha entre sete categorias de itens, incluindo cadeiras, mesas e banheiros, e depois gira a câmera para informar a direção e a distância desses itens. Além disso, se você tirar uma foto diretamente no aplicativo, a IA fornece uma descrição detalhada da foto capturada.

Vigia (vídeo=google)

Também lançamos um aplicativo Android chamado “Look to Speak” que ajuda pessoas com deficiência de fala a se comunicarem.

Look to Speak é um aplicativo que usa seus olhos para identificar frases, símbolos, símbolos, imagens, etc. A tecnologia de rastreamento ocular foi aplicada através da câmera frontal.

Olhe para falar (Vídeo – Google)

Além disso, a empresa lançou o “Project Gameface”, um mouse para jogos com viva-voz para Android que permite que pessoas com tetraplegia controlem um cursor de computador usando movimentos de cabeça e expressões faciais.

Os desenvolvedores podem criar aplicativos que permitem aos usuários personalizar expressões faciais, tamanho do movimento, velocidade do ponteiro e muito mais. Ele está disponível como código aberto no GitHub.

Projeto Game Face (vídeo = Google)

Além disso, pessoas com deficiência visual podem obter instruções de voz detalhadas e funções de leitura de tela para percursos pedestres através do “Lense” no Google Maps. Se você usar o recurso de leitor de tela Lens no Google Maps, poderá ouvir os nomes e categorias de locais próximos, como caixas eletrônicos, restaurantes e estações de transporte público, e a distância até esses locais.

Isso permite que você se oriente rapidamente e decida para onde está indo. Além disso, a função de orientação por voz passo a passo fornece orientação por voz sobre se você está indo na direção certa, se está atravessando um cruzamento movimentado ou se pode mudar de faixa se seguir na direção errada.

Operadores de teatros, academias, templos religiosos, auditórios, etc. podem adicionar o atributo “Auracast” aos seus perfis do Google Maps para pessoas que precisam de assistência auditiva. Isso ajuda você a ouvir melhor os sons com aparelhos auditivos, fones de ouvido e fones de ouvido Bluetooth habilitados para Auracast.

Repórter Park Chan cpark@aitimes.com

“Pensador. Aspirante a amante do Twitter. Empreendedor. Fã de comida. Comunicador total. Especialista em café. Evangelista da web. Fanático por viagens. Jogador.”